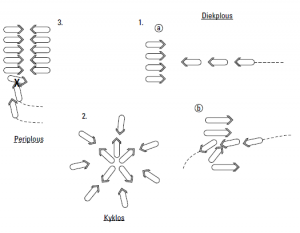

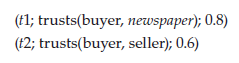

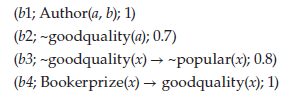

Od 2008 r. obserwuje się wzrost zainteresowania środowiskami zorientowanymi na usługi, które dążą do bezproblemowej integracji zasobów obliczeniowych i pamięci masowej. Kluczową cechą wszystkich tych systemów jest to, że dostawcy tych systemów oferują usługi, które mogą być wywoływane zdalnie, a użytkownicy wykorzystują te usługi do swoich aplikacji. Jednak pomimo wzrostu aktywności, licznych zalet i zainteresowania, istnieją pewne obawy, które zagrażają wizji tych środowisk jako nowego modelu zakupów IT i jego przyjęciu przez społeczność. Jednym z głównych problemów jest brak skutecznych metod zapewniania i wykrywania dostawców wrażliwych aplikacji użytkowników. Istnieje potrzeba wyboru usługodawców, ponieważ wrażliwe aplikacje i dane użytkowników są umieszczane w zasobach obliczeniowych usługodawców, w które można łatwo manipulować, chyba że dostawcy zapewnią bezpieczeństwo danych użytkowników. Do tej pory jedynym zapewnieniem ze strony dostawców dla użytkowników jest podpisanie umowy o gwarantowanym poziomie usług (SLA) przygotowanej przez dostawców tych systemów. Jednak z powodu nieuzasadnionego interesu usługodawców może się zdarzyć, że umowa SLA może zawierać niekompletne, fałszywe lub nawet niejasne opisy usług, co może wprowadzać użytkowników w błąd i sprawiać, że usługi będą otwarte, niepewne i zwodnicze. Co więcej, przy określaniu ustawodawstwa w umowie SLA, wewnętrzne lub zewnętrzne zasady, które miałyby być przestrzegane podczas tej usługi, nie mają z tym żadnego konotacji, ponieważ nie ma metody pomiaru, czy te pisemne zasady były rzeczywiście przestrzegane przez usługodawców, czy też nie. W związku z tym, jeśli użytkownicy są w stanie upewnić się co do usługodawcy przed przekazaniem swoich poufnych danych i aplikacji, ich pewność wykonania pracy przez tego konkretnego usługodawcę wzrasta, pomagając im delegować pracę bez obaw. W przypadku wyboru różnych dostawców tradycyjne metody, takie jak autoryzacja PKI, zawodzą z powodu skali i relacji ad hoc, które istnieją między dostawcami a żądającymi systemu. Ponieważ zaufanie i reputacja są postrzegane jako mierzalne przekonanie, które wykorzystuje godne zaufania doświadczenia do podejmowania decyzji w wielu dziedzinach, od starożytnego systemu rynku rybnego po handel elektroniczny, środowisko usług online, czujniki bezprzewodowe i sieci ad hoc do wybierania węzłów przekaźnikowych do przekazywania pakietów [ 6]. Nawet metody zarządzania oparte na zaufaniu zostały zastosowane w przypadku przetwarzania sieciowego i przetwarzania w chmurze poprzez wybór zasobów. Opierając się na pojęciu społeczeństwa ludzkiego, w którym rekomendacje są brane od zaufanych znajomych w celu podjęcia decyzji spośród mnóstwa wyborów, proponuje się wieloagentową strukturę rozwoju i oceny dostawców, opartą na mierniku ich reputacji. Klient użytkownika wybiera godnego zaufania agenta dostawcy dla swoich poufnych aplikacji za pomocą procesu rekomendacji społecznych, wysyłając zapytanie do swoich zaufanych znajomych, którzy z kolei mogą dalej wysyłać je do swoich znajomych w celu uzyskania rekomendacji, jeśli Ttimeout na to pozwala, gdzie Ttimeout to określony czas przez klienta użytkownika, aby uzyskać zalecenia. Jeśli jednak użytkownik jest nowy w systemie i nie ma żadnych godnych zaufania znajomych, to najpierw wchodziłby do sieci zaufania agentów, przyjmując rekomendacje innych agentów na temat ich godnych zaufania znajomych. Sieć zaufania to sieć agentów, w której każdy agent przechowuje informacje o zaufanych znajomych, tworząc w ten sposób „sieć”. Zalecenia przekazane agentowi użytkownika w celu podjęcia decyzji o zaufanych znajomych lub usługodawcach są podawane jako atrybuty żądanego podmiotu na podstawie funkcji rozkładu w czasie, przy założeniu, że najnowsze informacje mają większą wagę niż przeszłe interakcje. Aby poradzić sobie z niepewnością i niejasnością z tych zalecanych atrybutów, gdy są one podawane jako dane wejściowe do silnika wnioskowania rozmytego, atrybuty podają reputację jednostki jako dane wyjściowe, o które poproszono o rekomendacje. W przypadku obliczania reputacji rekomendowanych dostawców usług atrybuty dostarczane do silnika wnioskowania rozmytego są połączeniem ważonego, bezpośredniego doświadczenia, a także informacji zalecających. Podsumowując, omówmy następujące punkty: Po pierwsze, wyjaśnia się potrzebę wyboru dostawców usług w środowiskach zorientowanych na usługi, a następnie uzasadnia to. Podstawy systemów wnioskowania rozmytego (FIS), które są używane do rozwiązywania niepewnych zaleceń, są omówione w następnej sekcji. Następnie znajduje się sekcja dotycząca priorytetyzacji dostawców usług korzystających z FIS w oparciu o reputację z aktualizacją zaufania do rekomendujących. Kończyt omówieniem dwóch aplikacji, w których można zastosować proponowaną strukturę